Недавно вышел препринт от Carnegie Mellon, Oxford, MIT и UCLA — рандомизированное исследование на 1222 участниках про то, как работа с ИИ влияет на персистентность. Персистентность здесь означает настойчивость, готовность не бросать задачу, когда становится трудно. В образовательных исследованиях это один из самых сильных предикторов долгосрочного обучения.

Находка, если коротко: после десяти-пятнадцати минут работы с ИИ-ассистентом персистентность у участников падает. Они чаще пропускают трудные задачи, чем контрольная группа, которая ИИ не использовала. Эффект виден уже в первой сессии.

Самое интересное — не это. В Эксперименте 2 авторы разделили тех, кто пользовался ИИ, на три группы по паттерну использования:

— 61% просили ИИ дать готовый ответ

— 27% просили подсказку или уточнение

— 12% сказали, что ИИ не пользовались вообще

На предварительном тестировании эти три группы показывали одинаковые результаты. А на финальном, когда ИИ убрали, картина разошлась. Группа «дайте ответ» показала худший результат и самый высокий процент пропусков. Группы «дайте подсказку» и «не пользовался» показали результаты как у контрольной или лучше.

Хочется сделать вывод в духе критической ИИ-грамотности: учитесь быть hint-seeker, а не answer-seeker. Используйте ИИ, чтобы помочь себе думать, а не чтобы заменить мышление.

Вывод разумный, но можно пойти дальше.

В исследовании участник решает задачу — свою собственную, руками, ИИ выступает помощником. Вся дихотомия «ответ vs подсказка» существует внутри этой рамки: задача твоя, вопрос только в том, сколько ты ее делаешь сам.

Но вокруг меня все больше людей, которые в этой рамке вообще не находятся: они не решают задачу — они настраивают систему, которая решает задачи. И это не третий вариант между «ответом» и «подсказкой», а другой уровень игры.

Я бы выделил три роли в работе с ИИ. Они не взаимоисключающие, один человек может быть во всех трех. Но навыки и отношение к работе у них разные.

Пользователь. Работает с готовым ИИ-продуктом, решая собственную задачу. Студент с ChatGPT, журналист с Клодом, дизайнер с Midjourney. Именно эту категорию и мерили в исследовании. Дихотомия answer-seeker / hint-seeker полностью про них. И здесь вывод Slow AI работает: привычка запрашивать готовый ответ подтачивает настойчивость в собственном предмете.

Специалист по ИИ. Тот, кто создает или дорабатывает сами модели. Инженер в Anthropic, исследователь в университете, разработчик, файнтюнящий модель под корпоративный домен. Отдельная роль, в этот разговор она не входит.

Оператор. Человек посередине. Не пользователь, потому что его задача не решить конкретный пример, а выстроить процесс, который будет решать такие примеры. И не специалист по ИИ, потому что он не делает модели, он их собирает, настраивает и встраивает в работу.Формула Каспарова Контент-пайплайн, автоматизация рутинной операции, система из нескольких агентов под конкретный рабочий процесс.

Вот про оператора в исследовании нет ни слова. Это не упрек авторам, они мерили то, что мерили. Но когда мы переносим их вывод на «как учить работе с ИИ», оператор выпадает из картины, потому что в экспериментальном сетапе его не было.

А его отношение к персистентности другое. Оператор не упирается в «решу ли я этот пример по дробям» — он упирается в «построю ли я работающий пайплайн, который решает такие примеры». Его настойчивость работает на другом уровне, и, возможно, на более требовательном: пайплайн падает чаще, чем решается задача, и собрать его — работа куда более длинная, чем просто решить пример.

И вот, что меня на самом деле зацепило в контексте преподавания и размышлений о том, что и как измерять в обучении ИИшкам.

Стандартная рамка обучения с ИИ сейчас выглядит так: учим делать хорошую презентацию, по ходу учим пользоваться ИИ. Метрика — качество презентации. Использовал ИИ грамотно — получилась лучше. Если ориентироваться на свежий препринт, добавляется оговорка: только следи, чтобы не просить готовые ответы, иначе потом сам не сможешь.

Я хочу другую рамку. Я учу строить пайплайны. Презентация в этой рамке — побочный артефакт, а главное — система, которая умеет производить презентации, email-рассылки, отчеты, что угодно. И метрика должна быть не «хороша ли эта конкретная презентация», а «насколько человек способен собрать работающий процесс под новую задачу».

Это разные навыки — в них успешны разные ученики, и измерять надо разное.

Если мы продолжаем мерить по старой линейке, по качеству конкретного артефакта, мы систематически недооцениваем тех, кто уже перешел в операторский режим. У них презентация может получиться средней, потому что они не вылизывали ее руками. Но они за то же время собрали процесс, который выдаст пятьдесят таких презентаций с тем же качеством. По старой линейке так себе результат. По новой — другой порядок.

Вопрос, на который у меня пока нет ответа: как учить операторству и как его измерять? Решаемо ли это в формате курса, или это только через тысячи часов практики с реальными задачами? И насколько тут нужна предметная экспертиза, может ли хороший оператор быть слабым в предмете, или оператор без decent-уровня в предмете не соберет работающий пайплайн?

Мой рабочий ответ — decent-уровень обязателен. Но тут я уверен наполовину.

Если двигаться от рамки исследования (пользователь) через operator-режим к более крупному масштабу, открывается еще один уровень, который я хочу зафиксировать отдельно.

На эссе Джорджа Сивулки, CEO Hebbia, я вышел через канал The Future of Work — там же лежит русский перевод и аудио. Заголовок «Productive Individuals Don’t Make Productive Firms», тезис простой: ИИ повысил производительность каждого человека в десять раз, а компании в десять раз дороже не стали. Куда делась производительность?

Сивулка достает аналогию — в 1890-х электричество тоже обещало кратный рост. Текстильные фабрики Новой Англии заменили паровые двигатели на электрические, и тридцать лет ничего не происходило. Технология стала намного лучше, организация работы осталась прежней. Прирост случился только в 1920-х, когда заводы перепроектировали с нуля: индивидуальные двигатели в каждое оборудование, конвейерная линия, новое распределение работы между людьми и машинами. Двигатель тот же, порядок другой.

Сейчас, по Сивулке, ровно та же ситуация: двигатель заменили, завод не перепроектировали.

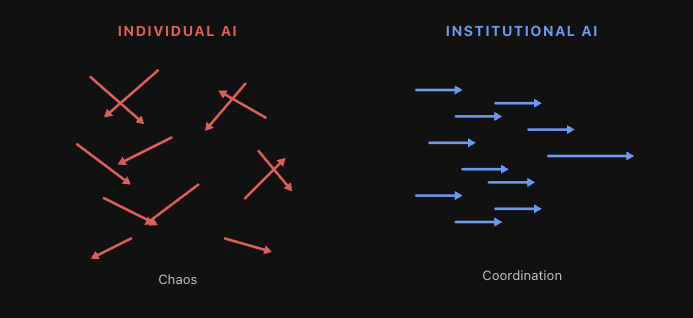

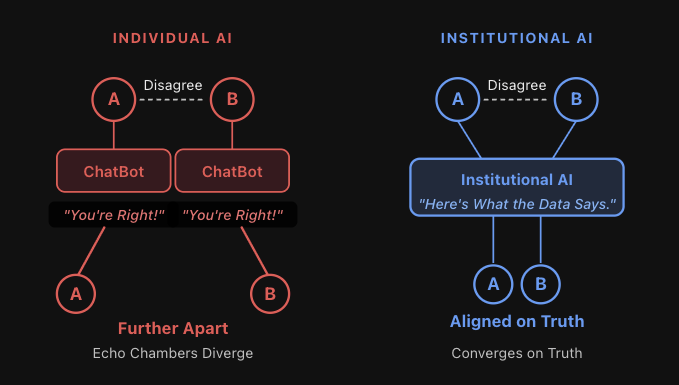

Из этого выпадает важное следствие для моей картинки про три роли. Операторы внутри организации — это еще не институциональный ИИ. Это просто продуктивные люди с собственными пайплайнами. И они складываются в продуктивную фирму примерно никак: у каждого свой стиль промптов, своя выдача, свои привычки, свои инструменты. Организационная схема существует, реальный поток работы говорит о другом.

Институциональный ИИ — другой класс продукта. Сивулка перечисляет семь его свойств, и почти все они про координацию: индивидуальный ИИ создает шум, институциональный находит сигнал; индивидуальный поддакивает пользователю (привет, RLHF), институциональный обязан возражать; индивидуальный экономит время, институциональный приносит доход. Все это не сумма индивидуальных продуктивностей, а другой слой.

Картинка, к которой я в итоге пришел, вырастает из тех же трех ролей, что я разбирал выше, но смещает в них акцент. Пользователь решает свою задачу. Оператор строит систему, которая решает такие задачи. А институциональный ИИ — это уже не еще одна роль человека, а свойство организации: когда системы операторов перестают мешать друг другу и начинают складываться во что-то общее. Препринт меряет первое. Я учу второму. Сивулка пишет про третье.

К этой картинке хочу прицепить одну старую формулировку, которая звучит по-новому. Джон Хейгель: «Смысл быть в организации — учиться быстрее, чем мы могли бы учиться самостоятельно». Я ее встретил у Наташи Бабаевой еще до всей волны AI. Хейгель дает одно из самых чистых определений организации — ускоритель обучения: один учишься медленнее, и это работало.

И вот этот контракт сейчас начинает сыпаться. Если у меня Клод, Cursor и пара агентов, я учусь быстро и сам. Зачем тогда организация. Это скрытая логика операторского режима, доведенная до края: суверенный оператор постепенно перестает нуждаться в команде.

У меня есть подозрение, что организация все равно нужна, просто ее ценность смещается. Среда для вопросов, которые ИИ не умеет задавать. Координация, без которой команда суверенных операторов превращается в коворкинг с общей подпиской на Клода. Ставки длинного горизонта, которые одному не поднять.

Какую рамку выбирать — это уже разговор про того, кого учишь и зачем.