Выступал на Podlodka Crew — полтора часа живой сборки автоматизации перед залом разработчиков. Я не программист. Звучит как рецепт катастрофы.

Задача была простая в формулировке: собрать систему, которая следит за YouTube-подписками и присылает в Telegram только то, что стоит смотреть. Не саммари из десяти каналов. Наоборот — тишину. «Не фильтровать, а не пропускать то, что мы зададим как шум, оставляя только сигнал».

У всех одна проблема — каждую неделю выходят новые модели, фреймворки, инструменты. Хочется за всем следить. Физически невозможно. И первый импульс — найти готовый инструмент. Но на There’s an AI for That десятки тысяч вариантов. Искать идеальный фильтр контента — тот же информационный перегруз, только мета-уровнем выше.Как найти свою систему работы с информацией Трейдоф: потратить полдня на поиск того самого инструмента или собрать свой за час. Я предложил второй путь.

Сначала — проектирование, потом кубики

Но прежде чем открыть n8n, я сделал кое-что, что обычно пропускают. Поговорил с AI. Не про кубики. Про задачу. Зачем это нужно, какие данные, откуда берутся, что на выходе. PRD. Схема. «Это работа для AI — работа человека в том, чтобы классно запроектировать, запромтить, обсудить, зачем это нам нужно, подготовить PRD». Когда мы чем-то владеем — хочется сразу бросаться строить кубики. Парадокс в том, что проектирование — это и есть сложная человеческая работа. Сборка — задача для машины.

Шаг первый: минимальный пайплайн

А потом начал с самого маленького. RSS-фид канала Подлодки → проверка на дубликаты → уведомление в Telegram. Три кубика в n8n. Работает за 10 минут. И вот этот момент — когда что-то живое уже крутится — для меня самый ценный. Не нужно начинать с чистого листа: встроенный помощник n8n делает черновик сценария из промта. Он ошибется. Но цель не в идеальности — в том, чтобы было от чего оттолкнуться. Бойлерплейт от AI никогда не заработает на 100%. Это нормально и полезно.

Шаг второй: субтитры

Firecrawl выкачивает их из видео (~1 цент за запрос), и теперь у меня есть текст, который можно оценить. YouTube не отдает субтитры текстовым файлом — нужно скачивать чанками и склеивать. Firecrawl решает это за секунды. Когда гипотеза подтвердится — можно навайбкодить свою апишку или поднять YouTube Transcript API с GitHub. Но для прототипа — идеально.

Шаг третий: AI-скоринг

AI-агент ставит оценку по 100-балльной шкале. Пять критериев: релевантность, глубина, применимость, новизна, качество изложения. Порог — где-то 80 баллов. Структурированный вывод — JSON со score. Больше ничего. «Задача классификации в автоматизациях — супер адекватное место использования искусственного интеллекта».От контекста к агентам: эволюция работы с ИИ Агент здесь работает, потому что вход недетерминирован (субтитры чужого видео), а выход должен быть числом.

(Подбирать порог — отдельное приключение. На подписках Подлодки видео оказались с высокими рейтингами — пришлось поднять до 86, чтобы фильтр реально фильтровал. В боевом режиме на моих подписках 90% не проходит. Подбирается эмпирически. Это нормально.)

Шаг четвертый: аннотация

Прикрутил Haiku с промтом «напиши аннотацию так, чтобы мне захотелось посмотреть, и добавь шуточку». Модель через OpenRouter — Grok для скоринга (дешевый, быстрый, большое контекстное окно), Haiku от Anthropic для саммари. Получаю в Telegram: название, ссылку, оценку и маленький текст. «Хеш-таблицы — скучновато звучит. Но погодите, вы задумывались, почему они работают как чудо?» Примерно так.

Демо-эффект

И тут случился демо-эффект. Облачный n8n выдал 503 прямо во время показа. Переключился на self-hosted — и это, кажется, был самый наглядный аргумент за собственный сервер, который я мог придумать. Незапланированный, но убедительный. (Self-hosted n8n поднимается за 20 минут с Claude Code на VPS от 2 ГБ RAM. Облачный — 20 $/мес, 10 000 запусков кубиков.)

90% логики — без AI

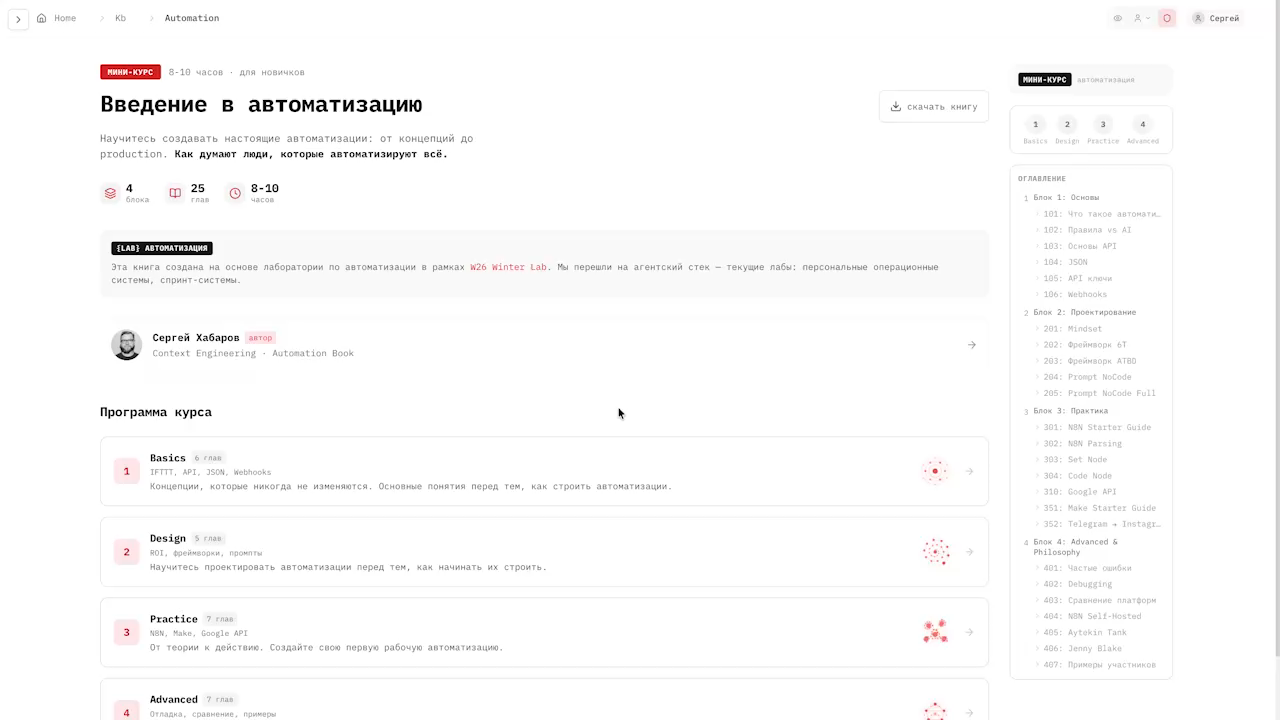

Вот принцип, который я повторяю на каждом обучении: 90% автоматизации — детерминированная логика. Расписание → данные → фильтр → уведомление.Введение в автоматизацию: книга для тех, кто хочет понять, а не просто нажимать кнопки Никакого AI. «Нет ничего зазорного, мягко говоря, в том, что в продакшене работает такая детерминированная логика». Агенты нужны в ~10% случаев — когда вход неопределен или когда тулы передают данные между собой. Не больше.

Зачем n8n, если можно навайбкодить?

Вопрос не «что лучше». Вопрос — что подходит задаче. n8n удобен для итерации, прототипа, и — штука, которую все недооценивают — его можно отдать нетехническому коллеге. «Вот смотри, входи вот в этого агента и вот этот промт. Ты можешь его тюнить сколько хочешь». Человек под себя настроил автоматизацию, не дергая айтишника. В этом много смысла.

А еще n8n как инструмент подготовки контекста для более мощных агентов — в Cursor, Claude Code. Сценарий болтается в облаке, собирает данные, поставляет контекст. А дальше работает coding agent. Два слоя, каждый на своем месте.

Сценарии, которые работают годами

Сценарии, которые просто лежат в облаке и работают годами — недооцененная ценность. У нас в команде есть бот, который каждое утро присылает погоду по городам — кто в Ереване, кто в Москве, кто на Бали. «Просто мило. Вообще смысла не особо в этом есть, но это дико мило». А есть кое-что серьезнее: после каждой встречи — транскрипт автоматически превращается в задачи в нужном проекте, с нужным статусом, с шерингом. Через 5 минут человек получает summary в Telegram со ссылкой. Это мой залюбленный кейс.

Что автоматизировать

Вот мой критерий: «то, что ненавидишь, что делаешь по многу раз и то, что прекрасно представляешь, что должно получиться на выходе». Короче — задачи, которые раньше отдавали джуну. Джун в облаке. Скучно, повторяемо, выход очевиден. Теперь это делает сценарий.

Кстати, я видел весь путь: один из наших проектов для школ начинался с 20 кубиков в Make. Потом перерос в n8n. Потом — в Python с базами данных и дашбордами. Черепаший путь от прототипа к продакшену. «До этого надо дожить, я бы так сказал». Переходить на код нужно тогда, когда уперся в реальный лимит n8n — не раньше.

Engagement vs relevance

Но вот что меня цепляет больше всего. Я делегировал AI решение о том, на что тратить внимание. Модель решает за меня, что достойно часа моей жизни. Раньше это делал алгоритм YouTube — и делал в свою пользу: оптимизировал engagement, время на платформе. Мой агент оптимизирует relevance. Разница не в технологии. В том, чьи критерии стоят в промте.

И это масштабируется. YouTube — один вход. Telegram-каналы конвертируются в RSS через десяток сервисов. Рассылки — тоже. Один пайплайн, десять источников, один промт. А если бот в общем чате команды — коллеги не тратят время на скроллинг. Лучшее с аннотациями приходит само.

Исходники

Четыре версии workflow от минимальной до полной, промты для старта и проектирования, слайды, схемы:

→ GitHub: podlodka-ai-crew-n8n

→ Запись выступления

· · ·

Забавная мысль на выходе. Технологии не снимают вопрос «зачем». Они делают его острее. «Придется думать про более сложные вещи — типа зачем, куда мы идем, нафига мы этим занимаемся». И нам придется искать ответы внутри себя.

Возможно, лучший навык 2026 года — не умение пользоваться AI. А умение построить AI, который фильтрует AI для тебя.

P. S. Облачный n8n так и не ожил до конца сессии. Self-hosted — 100% uptime.

P. P. S. Не показывайте ключи API в прямом эфире. Я, конечно, показал.

Частые вопросы

Зачем проектировать, если можно сразу собирать в n8n?

Проектирование разделяет человеческую работу и машинную. PRD, декомпозиция задачи, схема данных — это задачи человека. Сборка из блоков — задача машины. Пропуск проектирования означает, что вы быстрее строите неправильное. 30 минут на четкую постановку экономят часы перестройки.

Какая минимальная структура рабочего процесса?

Три блока: RSS-фид → проверка дубликатов → уведомление в Telegram. Собирается за 10 минут и сразу работает. Это не финальное решение — стартовая точка для итераций. AI в n8n может сгенерировать черновик из промпта. Он будет неточным, но это лучше, чем пустой экран.

Как AI оценивает релевантность контента на практике?

AI анализирует субтитры видео по пяти критериям: релевантность, глубина, применимость, новизна, подача. Каждый критерий — по 100-балльной шкале. Порог (например, 80 баллов) определяет, что дойдет до вас. Настройка происходит эмпирически — смотрите результаты и корректируете. На практике отсеивается до 90% контента.

Когда использовать AI в автоматизации, а когда обычную логику?

AI нужен там, где входные данные недетерминированы (внешние субтитры видео), а на выходе — суждение (оценка релевантности). Около 90% автоматизации — детерминированная логика: «если X, то Y». Расписания, перемещение данных, фильтрация. Не используйте AI для задач, где правила можно описать явно.

n8n или код — что лучше?

Зависит от задачи. n8n подходит для итераций, прототипов и — ключевое — его можно передать нетехнической команде для настройки промптов без привлечения разработчиков. Типичный путь: Make (до 20 блоков) → n8n (масштабируемый, self-hosted) → Python (когда упираетесь в ограничения). Не кодируйте преждевременно.

Как выбрать модель AI для разных задач?

Дешевые и быстрые модели — для детерминированных задач (проверка API, маршрутизация). Модели с сильным рассуждением — для оценочных (скоринг релевантности). В этом проекте: Grok для скоринга (дешевле, больше контекстное окно), Haiku для аннотаций. На масштабе сотен единиц контента стоимость и скорость решают.